(一)计算机系统概论[计组]

课堂内容+ 视频教程1.1 计算机组成原理(唐朔飞)_哔哩哔哩_bilibili

转载自:计算机组成原理 – Here_SDUT (fangkaipeng.com)

根据实际学习内容有一定的添加以及修改

1.1 计算机的分类

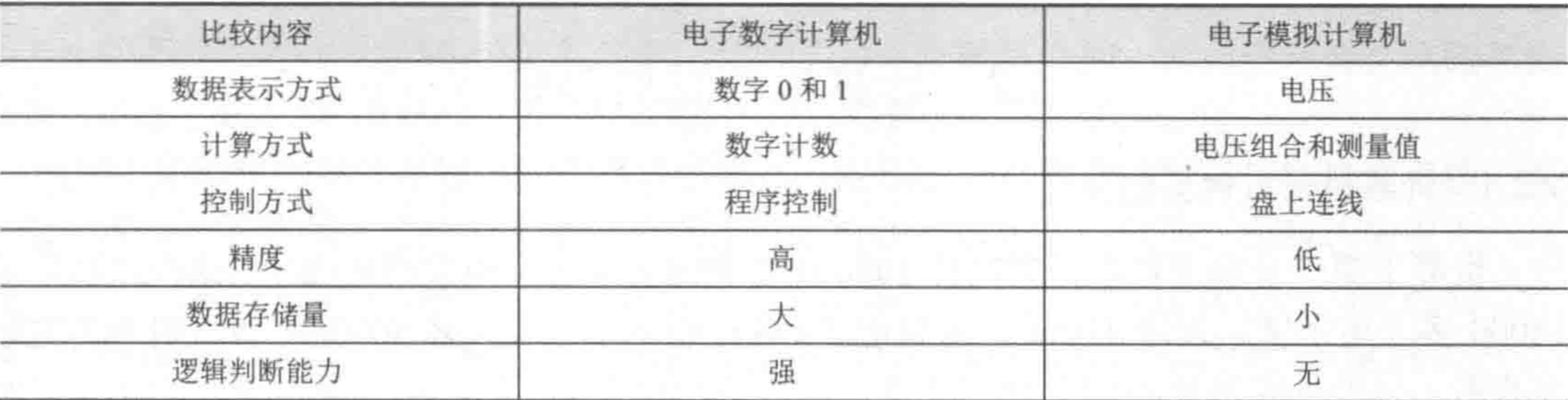

一、两大类

-

电子模拟计算机:数值由连续量表示,运算过程连续,受干扰大。

-

电子数字计算机:按位运算,不连续地跳动计算,抗干扰能力强。

二、电子计算机分类

- 专用计算机:最高效、经济、快速的方式,适应性差。

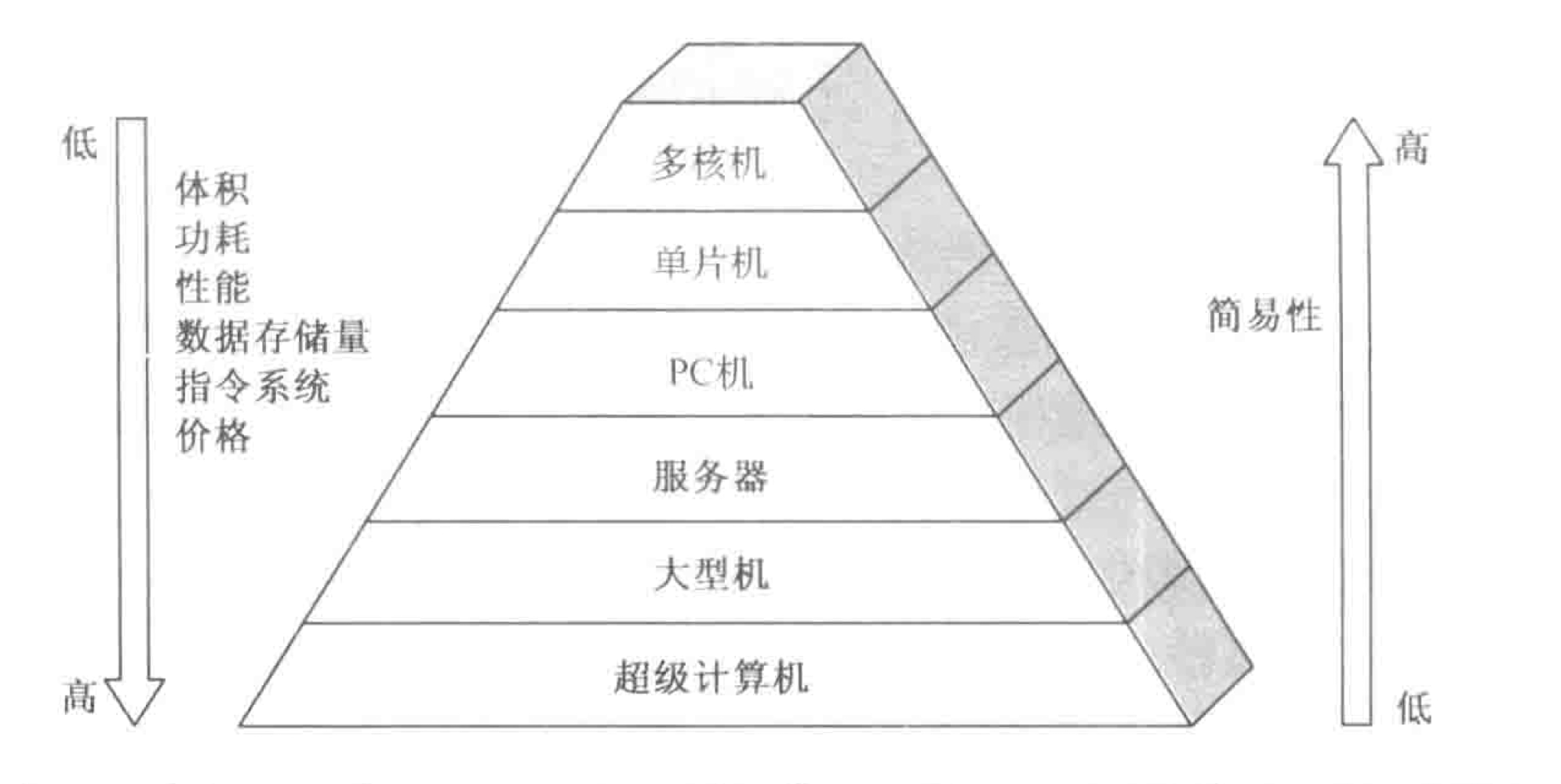

- 通用计算机:适应性强,牺牲效率、速度、经济性,细分为超级计算机、大型机、服务器、PC机、单片机、多核机。

1.2 计算机的发展简史

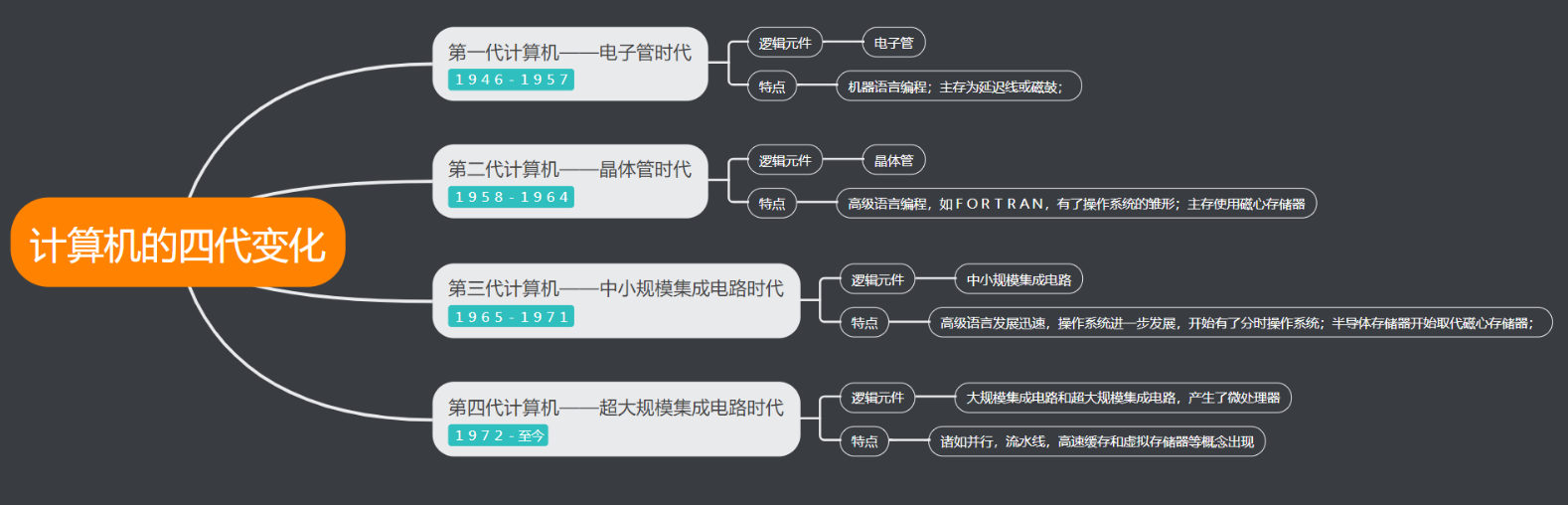

1.2.1计算机五代变化

- 1946-1957 电子管计算机——数据处理机

- 1958-1964 晶体管计算机——工业控制机

- 1965-1971 中小规模集成电路计算机——小型计算机

- 1972-1990 大规模和超大规模集成电路计算机——微型计算机,分为:多板机(多个印刷板)、单板机、单片机(一个芯片)

- 1991- 现在 巨大规模集成电路计算机——单片机

1.2.2 计算机的性能指标

衡量计算机性能的基本指标

- 响应时间(执行时间、等待时间)

- 吞吐量 (带宽): 表征一台计算机在某 一时间间隔内能够处理的信息量。

基本的性能评价标准是:CPU的执行时间

基准程序:专门用来进行性能评价的一组程序 , 用基准程序来评测计算机的性能

运算速度

-

响应时间:表征从输入有效到系统产生响应之间的时间度量,用时间单位来度量,包括等待时间和处理时间。

-

利用率:在给定的时间间隔内系统被实际使用的时间所占的比率,用百分比表示,实际处理时间/响应时间。

-

处理机字长:指处理机运算器中一次能够完成二进制数运算的位数,如32位、64位。

-

总线宽度:一般指CPU中运算器与存储器之间进行互连的内部总线二进制位数。

-

存储器容量:存储器中所有存储单元的总数目, 通常用KB、MB、GB、TB来表示。

-

存储器带宽:单位时间内从存储器读出的二进制数信息量,一般用字节数/秒表示。

-

主频/时钟周期:CPU的工作节拍受主时钟控制,主时钟不断产生固定频率的时钟,主时钟的频率(f)叫CPU的主频。度量单位是MHz(兆赫兹)、GHz(吉赫兹)。主频的倒数称为CPU时钟周期(T),

T=1/f, 度量单位是μs、ns。 -

CPU执行时间:表示CPU执行一般程序所占用的CPU时间,可用下式计算:

CPU执行时间 = CPU时钟周期数 * CPU时钟周期 -

CPI:表示每条指令周期数,即执行一条指令所需的平均时钟周期数。用下式计算:

CPI = 执行某段程序所需的CPU时钟周期数 + 程序包含的指令条数 -

MIPS (Million Instructions Per Second)的缩写,表示平均每秒执行多少百万条定点指令数,用下式计算:

MIPS = 指令数 + (程序执行时间 * 106) -

FLOPS (Floating-point Operations Per Second) 的缩写,表示每秒执行浮点操作的次数,用来衡量机器浮点操作的性能。

FLOPS = 程序中的浮点操作次数 / 程序执行时间(s) -

MFLOPS:每秒执行多少百万次浮点运算(

Floating-point Operations)

1.2.3 计算机性能的测量

- 比较计算机的性能时,用执行时间来衡量

- 完成同样工作量所需时间最短的那台计算机就是性能最好的

- 处理器时间往往被多个程序共享使用,因此,用户感觉到的程序执行时间, 并不是程序真正的执行时间(从hello程序执行过程可知)

- 通常把用户感觉到的响应时间分成:

- CPU时间:指CPU真正花在程序执行上的时间。又包括两部分:

- 用户CPU时间:用来运行用户代码的时间

- 系统CPU时间: 为了执行用户程序而需要运行操作系统程序的时间

- 其他时间: 指等待I/O操作完成或CPU花在其他用户程序的时间

- CPU时间:指CPU真正花在程序执行上的时间。又包括两部分:

- 系统性能和CPU性能不等价,有一定的区别

- 系统性能:系统响应时间,与CPU外的其他部分也都有关系

- CPU性能:用户CPU时间

CPU真正用在用户程序执行上的时间 = 指令数 * CPI * 时钟周期

- 即:

程序所含指令总数 * 每条指令所需时钟周期数(CPI) * 时钟周期长度

写题会用到的公式

- 时钟周期长度= 1/主频

- MIPS = 主频 / CPI 106*

- 运行时间 = 指令数 * CPI * 时钟周期

1.3 计算机的硬件

1.3.2 运算器

用来完成算术运算和逻辑运算, 并将运算的中间结果暂存在运算器内

主要功能是进行加减乘除等算术运算,还可以进行逻辑运算,又称为ALU(算术逻辑运算部件),计算机中通常采用二进制数,运算器长度一般是8、16、32、64位。

1.3.3 存储器(存放数据和程序)

存储器用来存放数据和程序

保存一个数的16个触发器称为一个存储单元,存储器由许多存储单元组成,每个存储单元有编号,称为地址,存取数据都要按给定的地址来寻找存储单元。

存储器所有存储单元的总数称为存储容量,存储容量大的磁盘存储和光盘存储称为外存储器,半导体存储器称为内存储器(内存)。

1.3.4 控制器

控制器用来控制、 指挥程序和数据的输入、运行以及处理运算结果

控制器是计算机中发号施令的部件,控制计算机各部件的工作。

1.计算程序

每一个基本操作称为一条指令,一串特定的指令序列称为某问题的计算程序,简称程序。

2.指令的形式

指令的内容由两部分组成:操作的性质和操作数的地址,前者为操作码,后者为地址码。

将接替的程序存放到存储器中称为存储程序,控制器依据存储的程序进行计算任务称为程序控制。存储程序并按照地址顺序执行,这就是冯诺依曼型计算机的设计思想。

- 冯诺依曼结构:指令和数据放在一个存储器中。

- 哈佛结构:指令和数据分别放在两个存储器中。

3.控制器的基本任务

把取指令的一段时间叫做取指周期,把执行指令的时间叫做执行周期,计算机系统中运算器和控制器组合在一个芯片中,称为CPU。

4.指令流和数据流

把组成一个字的二进制位数称为字长,可以是8位也可达到64位(影响精度)。如果某字代表要处理的数据,称为数据字,如果代表指令,称为指令字。取指周期中从内存中读出的信息流是指令流,流向控制器;执行周期中,从内存读出信息流是数据流,由内存流向运算器。

1.3.5 适配器与输入/输出设备

- 输入设备:把人们熟悉的某种信息形式变换为机器内部所能接受和识别的二进制信息形式。

- 输成设备:把计算机处理的结果变化为人或其他机器设备所能接收和识别的信息形式。

- 计算机的输入输出设备也称外围设备,通常需要一个适配器与主机相连。

- 系统总线是构成计算机系统的骨架,多个系统部件之间进行数据传送的公共通路。

1.4 计算机的软件

1.4.1 软件组成和分类

- 系统程序:各种服务性程序、语言程序、操作系统、数据库管理系统

- 应用程序:用户利用计算机来解决某些问题二编制的程序

1.4.2 软件的发展演变

机器语言编写程序(手编程序),这种计算机完全可以识别的程序又称为目的程序;再是约定一些格式表示不同指令(汇编语言),用指令编写程序,用汇编器将汇编程序语言翻译为目的程序;然后是接近数学语言的算法语言,如C,Java,算法语言编写的程序称为源程序,编译程序用于翻译成目的程序,运行系统协助目的程序运行,编译程序和运行系统合称为编译器。

1.4.3 软硬件关系

**软件和硬件的关系:**具有逻辑功能的等价性。

**发展趋势:****硬件实现的比例越来越高,软件所占的成本上升。

**硬件实现:**速度快,灵活性差;

**软件实现:**速度低,灵活性高。

随着大规模集成电路技术的发展和软件硬化的趋势,

要明确划分计算机系统软、硬件界限已经显得比较困难了。

因为任何操作和指令可以由软件来实现,也可以由硬件来实现,

取决于价格、速度、可靠性、存储容量、变更周期等因素。

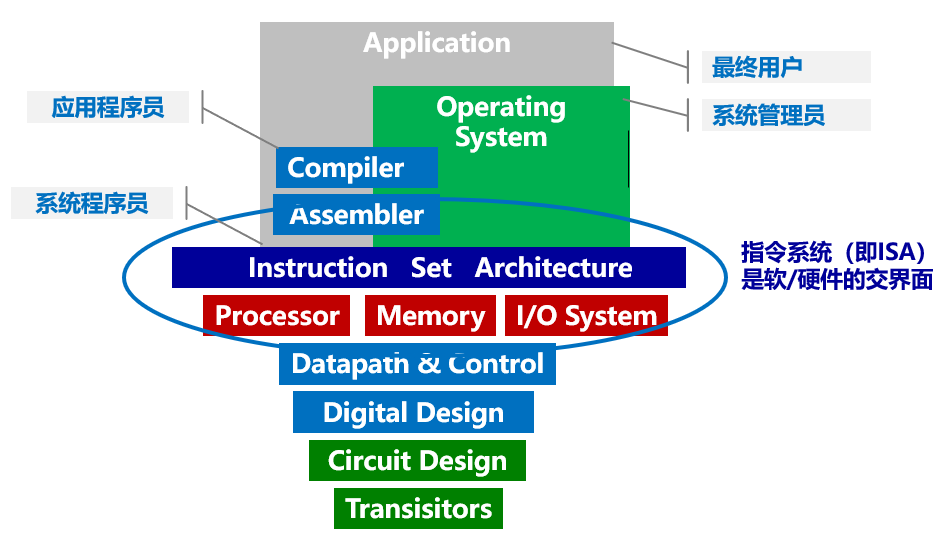

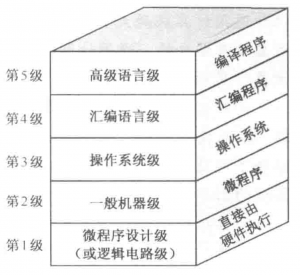

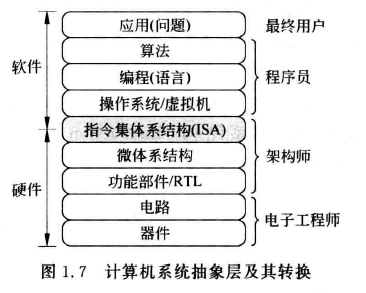

1.5 计算机系统的层次结构

1.5.1 多级组成的计算机系统

不同用户工作在不同层次,所看到的计算机不一样。

中间画圈部分是本课主要内容处于最核心的部分!

第一级到第三级编写程序采用的语言,基本是二进制数字化语言,机器执行和解释容易。

第4、5级编写程序采用的是符号语言,用英文字母和符号来表示程序。

1.5.2 软件与硬件的逻辑等价性

把复杂的、常用的程序制作成所谓的固件,就其功能而言,是软件,但从形态上来说又是硬件。

1.6 计算机的发展历程

1.6.1 冯·诺伊曼计算机

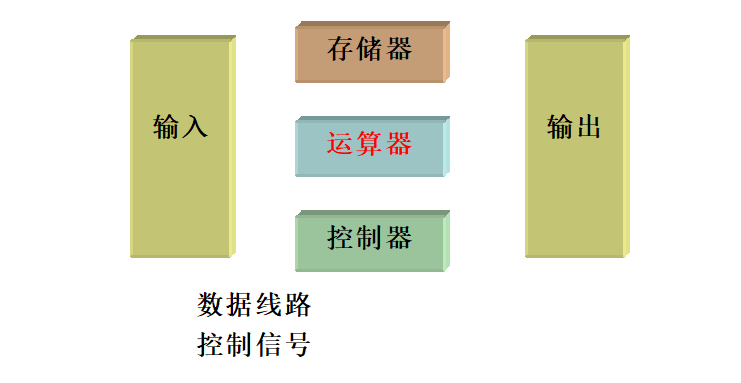

当代计算机体系结构的形式,是冯.诺依曼等人提出的计算机设计的一些基本思想。

冯·诺伊曼计算机的特点

1、计算机由运算器、存储器、控制器、输入设备和输出设备五大部件组成。

2、指令和数据以同等地位存放于存储器内,并可按地址寻访。

3、指令和数据均用二进制数表示。

4、指令由操作码和地址码组成,操作码用来表示操作的性质,地址码用来表示操作数在存储器中的位置。

5、指令在存储器内按顺序存放。

6、机器以运算器为中心,输入输出设备与存储器间的数据传送通过运算器完成。

典型冯.诺依曼计算机结构以运算器为中心:

- 输入输出设备与存储器之间的数据传送都途径运算器。

- 运算器、存储器、输入设备、输出设备的操作以及它们之间的联系都由控制器集中控制。

1.6.2 现在的计算机结构

- 不改变的:存储程序(冯.诺依曼思想精华)

- 改变的是:以存储器为中心,总线结构,分散控制。

1.6.3 计算机的更新换代

世界上第一台通用计算机“ENIAC”(Electronic Numerical Integrator And Computer)于1946年2月14日在美国宾夕法尼亚大学诞生。发明人是美国人莫克利(JohnW.Mauchly)和艾克特(J.PresperEckert)。

→ 电子管、继电器存储

→ 晶体管、磁介质存储

→ 集成电路

→ 大规模集成电路、超大规模集成电路

→ 智能计算机

就系统结构的发展而言,计算机经历了:

- 单个CPU单机系统 → 流水线机 → 多处理机 → 大规模的并行处理机

就执行技术的发展而言,计算机经历了:

- 变址技术→ 中断技术→ 微程序技术→ 缓冲技术共享→ 重用技术→ 虚拟技术

摩尔定律。摩尔定律是由英特尔(Intel)创始人之一戈登·摩尔(Gordon Moore)提出来的。其内容为:当价格不变时,集成电路上可容纳的元器件的数目,约每隔18-24个月便会增加一倍,性能也将提升一倍。换言之,每一美元所能买到的电脑性能,将每隔18-24个月翻一倍以上。这一定律揭示了信息技术进步的速度 。尽管这种趋势已经持续了超过半个世纪,摩尔定律仍应该被认为是观测或推测,而不是一个物理或自然法 。

半导体存储器的发展。1970年仙童半导体公司生产出第一个较大容量的半导体存储器,至今,半导体存储器经历了11代;单芯片1KB、4KB、16KB、64KB、256KB、1MB、4MB、16MB、64MB、256MB、1GB。

微处理器的发展。微处理器位数:8->16->32->64,这里的32、64指的是机器字长,是指计算机进行一次整数运算所能处理的二进制数据的位数。

1.6.4 计算机未来的展望

1、计算机具有类似人脑的一些超级智能功能

要求计算机的速度要足够快。

2、芯片集成度的提高收到以下三方面的限制

- 芯片集成度受物理极限的制约

- 按几何级数递增的制作成本

- 芯片的功耗、散热、线延迟

3、替代传统的硅芯片

- 光计算机:利用光子取代电子进行运算和存储

- DNA生物计算机:通过控制DNA分子间的生化反应

- 量子计算机:利用原子所具有的量子特性